大模型在機(jī)器視覺行業(yè)的落地路徑

在大模型火之前,機(jī)器視覺,是近5年來講AI、用AI最多,最頻繁的行業(yè)。業(yè)內(nèi)一些公司,也靠AI賺到了真金白銀。

2023年,GPT橫空出世,舉世沸騰,海量資金瘋狂入場(chǎng)大模型賽道。

但和AI糾纏了5年多的機(jī)器視覺行業(yè),對(duì)大模型,似乎沒那么熱情。

行業(yè)很分散,應(yīng)用很垂直,難通用。

中小玩家眾多,大模型對(duì)中小企業(yè)而言,就是奢侈品:一年的利潤不夠買一臺(tái)H100(小幾百萬)。

短期看,大模型對(duì)行業(yè)的影響有限;但長(zhǎng)期看(5-10年),更聰明、更靈活、更通用的AI,將給視覺行業(yè)帶來巨大的變革。

大模型的本質(zhì)

傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)AI,僅參考人類大腦,構(gòu)造了一個(gè)機(jī)器大腦,但學(xué)習(xí)過程,沒法參考人類的學(xué)習(xí)模式,僅針對(duì)少樣本或特定樣本,進(jìn)行學(xué)習(xí)。(主要原因,是以前無法高效的輸入足夠多的有效信息、數(shù)據(jù),且運(yùn)算能力也不夠強(qiáng)大)。

近10年,隨著互聯(lián)網(wǎng)信息的海量爆發(fā),以及硬件算力的持續(xù)增長(zhǎng),使高效的獲得足夠多的有效信息,并進(jìn)行大量運(yùn)算成為可能。AI科學(xué)家,參考人腦的結(jié)構(gòu)和學(xué)習(xí)過程,設(shè)計(jì)并訓(xùn)練神經(jīng)網(wǎng)絡(luò),并獲得了不錯(cuò)的結(jié)果。基于這種神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)和海量數(shù)據(jù)學(xué)習(xí)的AI,就是大模型。

一個(gè)嬰兒,從出生到3歲,眼睛從真實(shí)世界獲取的影像,約3億張---人類大腦的學(xué)習(xí)過程,就是不斷從外界攝入信息---視覺,聽覺,觸覺,味覺,運(yùn)動(dòng)感知等,不斷學(xué)習(xí),不斷提高,從而成為一個(gè)“通用”的人。

經(jīng)過海量學(xué)習(xí)的人腦,其實(shí)就是一個(gè)成功的通用大模型。

大模型,既參考人腦結(jié)構(gòu),還參考了人腦學(xué)習(xí)過程。

大模型,就像從大學(xué)畢業(yè)的學(xué)生,經(jīng)過訓(xùn)練,具備了很多通用的技能,掌握了再學(xué)習(xí)的技巧,再進(jìn)入陌生領(lǐng)域,只需要學(xué)習(xí)陌生領(lǐng)域的知識(shí),即可成為一個(gè)合格的“打工人”。

? GPT,就是世界頂級(jí)名校培養(yǎng)出來的學(xué)生,最聰明,最好用,最高效。

? 國內(nèi)大模型,就是國內(nèi)各頂級(jí)名校培養(yǎng)出來的學(xué)生,在國內(nèi)最聰明、最好用、最高效。

為什么人類會(huì)擔(dān)心大模型誕生出“自我意識(shí)”

大模型,參考人類大腦結(jié)構(gòu)和學(xué)習(xí)過程而來。

神經(jīng)網(wǎng)絡(luò)有輸入層,隱藏層和輸出層。其中,隱藏層有很多層,這個(gè)層,就是深度學(xué)習(xí)里的“深度“。這個(gè)隱藏層,也是最讓人類擔(dān)憂的地方---人類知道怎么訓(xùn)練他:不斷調(diào)整參數(shù)和試錯(cuò),從而獲得期望的結(jié)果。但人類還無法完全理解隱藏層內(nèi)部的運(yùn)作機(jī)制。這些模型具有數(shù)千億到上萬億的參數(shù),其復(fù)雜性超出了人類直覺的范圍。我們只知道how,不知道why。

大模型的參數(shù),類比于人類大腦突觸信號(hào)。GPT-4,據(jù)估計(jì)有1.7萬億個(gè)參數(shù),而人類大腦有100萬億個(gè)突觸,當(dāng)GPT-n也有和大腦突觸相同數(shù)量級(jí)的參數(shù)時(shí),人工智能是否會(huì)產(chǎn)生自我意識(shí)?拭目以待。

作為應(yīng)用者你需要知道大模型這些特點(diǎn)

大模型,可以看作是一種信息壓縮工具。

大模型,是用數(shù)學(xué)上的高維來處理低維的信息(例如,1維的文本數(shù)據(jù),2維的圖像數(shù)據(jù))。低維世界無法解決的海量信息間的關(guān)系、邏輯、差異、共性,在更高維度上,可被輕松的提煉、發(fā)現(xiàn)、總結(jié)和歸納出來。

宏觀世界0維的點(diǎn),在微觀世界,是3維的球。

宏觀世界1維的線,在微觀世界,是3維的繩。

宏觀世界2維的面,在微觀世界,是3維的磚。

高維能發(fā)現(xiàn)更多的信息:提取共同的特征,發(fā)現(xiàn)信息間的關(guān)系和連接邏輯等。

高維對(duì)低維世界的理解,可以說是一種透過現(xiàn)象看本質(zhì)的能力。通過高維的壓縮,低維海量的信息,就被“存儲(chǔ)”到大模型里。據(jù)估計(jì),一些大模型的信息壓縮比,約為8:1。

大模型在垂直領(lǐng)域的落地,是需要二次學(xué)習(xí)的,不能拿來就用。

大模型要應(yīng)用到視覺行業(yè)的細(xì)分領(lǐng)域、垂直應(yīng)用,是需要針對(duì)該領(lǐng)域,進(jìn)行有針對(duì)性的學(xué)習(xí)和訓(xùn)練(喂應(yīng)用數(shù)據(jù)和調(diào)參)----就像一個(gè)外行的人,進(jìn)入視覺行業(yè),也需要先學(xué)習(xí):了解行業(yè)的特點(diǎn)、客戶的需求、產(chǎn)品的功能等。

再好的大模型,沒有學(xué)過對(duì)應(yīng)的知識(shí),在陌生領(lǐng)域,也是小白。男怕干錯(cuò)行,女怕嫁錯(cuò)郎,大模型怕沒有二次學(xué)習(xí)的直接使用。

與傳統(tǒng)的,也需要樣本訓(xùn)練的AI相比,大模型有什么優(yōu)勢(shì)和不同?簡(jiǎn)單說來,就是大模型比傳統(tǒng)AI,更高、更快、更強(qiáng)、更靈活。

同樣的應(yīng)用:

? 傳統(tǒng)的AI,需要更多的樣本訓(xùn)練,大模型需要較少的樣本,甚至零樣本(基于大模型是否已具備該應(yīng)用所需的全部能力)。

? 傳統(tǒng)的AI,訓(xùn)練和部署周期常需要幾個(gè)月;大模型的訓(xùn)練和部署,可以更快,幾周,甚至幾天。

? 傳統(tǒng)的AI,泛化能力較弱,當(dāng)遇到與樣本差異較大的數(shù)據(jù)時(shí),處理結(jié)果不是很理想;而大模型的泛化能力較強(qiáng),對(duì)與樣本差異較大的數(shù)據(jù),處理準(zhǔn)確性更高。

針對(duì)細(xì)分領(lǐng)域、垂直應(yīng)用,大模型可以小型化、精簡(jiǎn)化。

越通用的大模型,其訓(xùn)練和使用所需要的資源,也越多。對(duì)于一個(gè)垂直應(yīng)用而言,把一個(gè)訓(xùn)練好的大模型,不做裁剪拿來就用,會(huì)導(dǎo)致超高的成本、效用也很低。

幸好,一個(gè)訓(xùn)練好的大模型,是可以裁剪的。這就是目前行業(yè)里所說的:大模型小型化,或,小的大模型。

以駕駛和做菜技能為例來說明。

駕駛和做菜,二者都需要具備對(duì)手的控制能力,但駕駛,不需要知道什么是雞蛋,什么是西紅柿;做菜,不需要識(shí)別紅綠燈。

? 對(duì)手的控制,是駕駛和做菜應(yīng)用都需要的能力,2個(gè)應(yīng)用上都保留。

? 識(shí)別雞蛋和西紅柿的能力,在做菜應(yīng)用上保留,在駕駛應(yīng)用上刪除。

? 識(shí)別紅綠燈的能力,在駕駛應(yīng)用上保留,在做菜應(yīng)用上刪除。

越細(xì)分、越垂直的應(yīng)用,其大模型越能小型化,低成本化。目前,業(yè)界已經(jīng)有嵌入式的小的大模型方案面世,就是針對(duì)機(jī)器視覺這類碎片、垂直類應(yīng)用。

算力、模型,都可以服務(wù)形式提供,算力as a Service, 模型as a Service。

對(duì)中小企業(yè)而言,成本,是大模型能否用起來的核心考量因素。中小企業(yè)不需要自己訓(xùn)練通用的大模型,但需要基于行業(yè)數(shù)據(jù),在某類大模型上,訓(xùn)練行業(yè)專精大(小)模型。

基于垂直應(yīng)用復(fù)雜度的不同,可以有多種模式選擇:

1、 租用政府或大型事業(yè)單位提供的算力和模型平臺(tái),進(jìn)行專用大模型的訓(xùn)練。

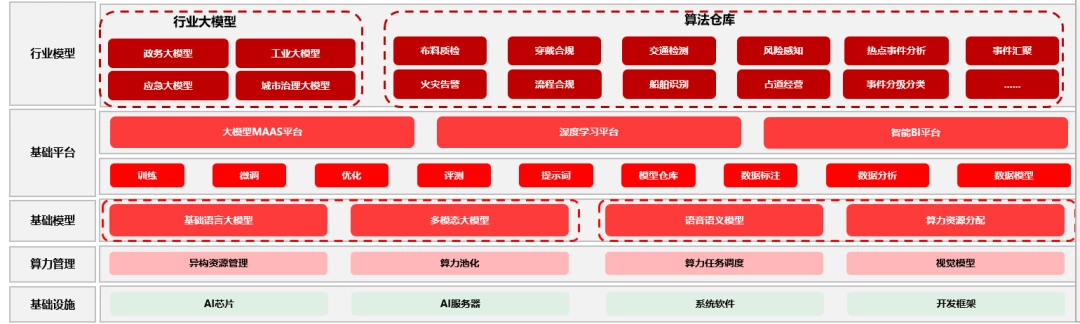

大模型基礎(chǔ)設(shè)施規(guī)劃

已經(jīng)有多個(gè)地市政府在建設(shè)這類可對(duì)外出租硬件、算力和大模型的平臺(tái)。要不了多久,為企業(yè)提供大模型租用服務(wù),或?qū)⒊蔀榈胤秸猩桃Y的標(biāo)配。

2、 與中大型AI公司合作,訓(xùn)練模型。對(duì)于一些大行業(yè),這類公司會(huì)先基于行業(yè)訓(xùn)練一個(gè)行業(yè)通用的大模型。中小公司,可在這類行業(yè)大模型上,裁剪訓(xùn)練自己的場(chǎng)景化的小模型,以確保模型應(yīng)用的最優(yōu)化。

3、 自建算力平臺(tái),訓(xùn)練模型。應(yīng)用越細(xì)分,需要的模型越簡(jiǎn)單,所需的算力也就越少。在一些很小的行業(yè),或很細(xì)分的領(lǐng)域,這種模式是可行的。

大模型能升級(jí)嗎?

就目前的大模型進(jìn)展而言,大模型是不能升級(jí)的,只能替換。

大模型,是基于海量數(shù)據(jù)訓(xùn)練,對(duì)神經(jīng)網(wǎng)絡(luò)的“神秘”改造而來。AI科學(xué)家都還弄不清大模型的機(jī)制,何談升級(jí)呢?

對(duì)于垂直應(yīng)用而言,基于1.0版本大模型訓(xùn)練出來的專用模型1.1,可以在1.1基礎(chǔ)上繼續(xù)訓(xùn)練、調(diào)參,獲得更優(yōu)的1.2, 1.3等版本。但如果要將可能更好的2.0版本大模型用于垂直應(yīng)用上,以達(dá)到更好的效果,則需要在2.0版本大模型上,重新訓(xùn)練一遍,獲得專用模型2.1、2.2。

不同代際大模型,不能升級(jí),不能OTA,只能替換和重新訓(xùn)練,是大模型落地所必須面對(duì)的一個(gè)挑戰(zhàn)。

機(jī)器人行業(yè)那么卷,具身智能會(huì)讓機(jī)器人行業(yè)煥發(fā)第二春?jiǎn)幔?/strong>

什么是具身智能?

像人一樣能與環(huán)境交互感知,自主規(guī)劃、決策、行動(dòng)、執(zhí)行能力的機(jī)器人,可稱之為“具身智能機(jī)器人”。它的實(shí)現(xiàn)包含了人工智能領(lǐng)域內(nèi)諸多的技術(shù),例如計(jì)算機(jī)視覺、自然語言處理、機(jī)器人學(xué)等。用通俗點(diǎn)的話來說,具身智能,就是通用機(jī)器人

。

機(jī)器人和機(jī)器視覺,是2個(gè)交叉的行業(yè),視覺系統(tǒng)為機(jī)器人提供基礎(chǔ)的感知,機(jī)器人大腦基于感知,控制機(jī)器人完成各類動(dòng)作。大模型出現(xiàn)以前的機(jī)器人方向,重點(diǎn)放在了運(yùn)動(dòng)控制,波士頓動(dòng)力的機(jī)器狗,是其極致代表。但因?yàn)閷?duì)外部世界的感知和處理不夠智能和靈活,機(jī)器狗的商用落地進(jìn)展緩慢。機(jī)器人行業(yè),主要還是聚焦在各個(gè)細(xì)分領(lǐng)域,讓機(jī)器人執(zhí)行比較單一的任務(wù)和動(dòng)作,可快速商用落地。

大模型出來后,業(yè)界看到了機(jī)器人具備“通用智能”的可能。機(jī)器人擁有一個(gè)聰明的大腦,能夠聽懂人類語言,然后,分解任務(wù),規(guī)劃子任務(wù),移動(dòng)中識(shí)別物體,與環(huán)境交互,最終完成相應(yīng)任務(wù)。國外,有機(jī)構(gòu)用三個(gè)大模型(視覺導(dǎo)航模型、大型語言模型、視覺語言模型)教會(huì)了機(jī)器人在不看地圖的情況下按照語言指令到達(dá)目的地。

Tesla和Agility的人形機(jī)器人,都是具身智能的探索方向---在限定場(chǎng)景下的具身智能,已經(jīng)有較大希望商用落地。

北京機(jī)器視覺大會(huì),約起來

工業(yè)AI、工業(yè)大模型、視覺大模型、具身智能等概念,是2024年機(jī)器視覺行業(yè)的熱門話題。

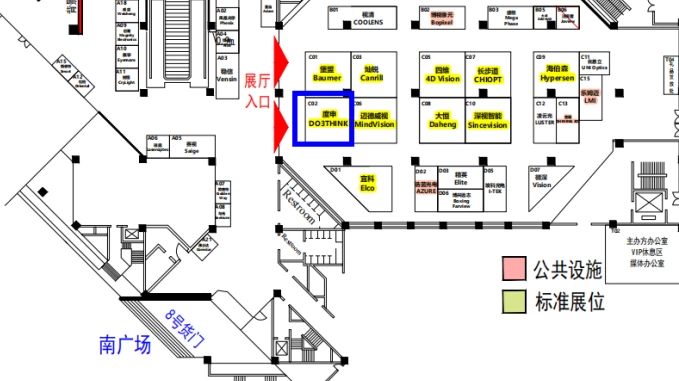

5月21日-5月22日,北京機(jī)器視覺大會(huì)將在國家會(huì)議中心4,5號(hào)館進(jìn)行。眾多大模型廠家、行業(yè)AI廠家、頭部硬件廠家均有參加。度申也將在大會(huì)上做相關(guān)主題分享,歡迎聆聽,并光臨度申展位,一起探討交流行業(yè)大勢(shì)。

返回列表

返回列表

_1657772558.webp)